聚焦新兴的量子计算机技术

1970年代,英特尔创始人Gordon Moore首度发表“摩尔定律”,他指出每隔18到24个月,同样一颗集成电路(IC)可容纳的晶体管数目就会倍增、使性能同步提升。其后半世纪,IC制程技术就几乎遵循摩尔定律,每隔二年推进一个世代的速度演进,带动了个人电脑、手机、物联网、云计算产业的蓬勃发展,IC芯片堪称现代科技业所不可或缺的重要战略物资。

2020年,先进半导体制程已迈入5纳米时序,紧接着2022年底3纳米芯片将准备量产,并预期1至2纳米芯片可望在不久后问世。然而,碍于先进半导体制程即将面临原子尺寸的微缩工艺挑战,摩尔定律将可能在2030年前走入终点,因此全球开始将目光放在新兴量子计算机(Quantum Computer)技术布局与研发方向上。

例如美国《国家量子启动法案》、欧盟《量子技术旗舰计划》、日本《光/量子飞跃旗舰计划》、中国的《十四五规划》、俄罗斯《量子行动计划》等,显示各方正积极争取量子科技的话语权。而国际科技巨头IBM、Google等早已积极规划量子计算机技术的蓝图,IBM更直言未来五至十年内,量子计算机将可进入商用化市场。

现今市面上的各种计算装置皆为“经典计算机(Classical Computer)”,其原理是透过集成电路上密布的微小晶体管元件来运作,借控制电流通过与否来记录数据,如开为“1”、关为“0”,亦称为二进位制的经典比特(Bit),它仅具备单向计算能力,随着问题复杂度的提升,其所需的计算时间亦将同步大增。

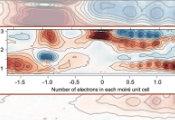

所谓“量子计算机”是基于微观量子力学理论来设计的,是一种可针对特定复杂问题进行快速计算的次世代电脑。其最小计算单位“量子比特”(Qubit),可同时记录0与1两个数据,就好像既活又死的“薛定谔的猫”,且每增加1个量子比特,其计算量将呈指数级增长,仿佛拥有并行计算的能力。

举例来说,经典计算机N个比特的信息量就是N,而N个量子比特的信息量却高达2的N次方。因此,当量子比特数来到50个时,将可在同一时间计算高达1125兆次,这种计算能力已凌驾于当今世界最强的超级计算机,它可挑战真实世界难以处理的超复杂问题,例如即时车队派遣、投资组合、新药研发等商业领域的问题。

目前量子计算机有两大发展途径,一是遵循量子力学的“通用量子计算机”,是由许多量子比特组成的物理系统,可执行各种量子算法,如大数质因数分解的Shor算法、非结构化资料库搜索的Grover算法等。

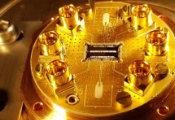

当前量子计算机硬体的物理实现方式呈现百家争鸣,如IBM与Google的超导体、Honeywell与ionQ的离子阱、Intel的量子点等,至今还无法评判哪种技术最终会能胜出,不过它们的共通点都是硬体投资门槛相当高,部分技术更要求有超低温的操作环境。

另一种是“量子启发计算机”,这是运用经典“比特”来模拟量子计算机的替代方案,它有固定的电路设计,只适用于“特定计算”的算法与问题模型,并能取得优于经典计算机的“加速”结果。其主要优点是可在常温下操作,相较“通用量子计算机”更容易商用化,如日本富士通的“数字退火计算机”。